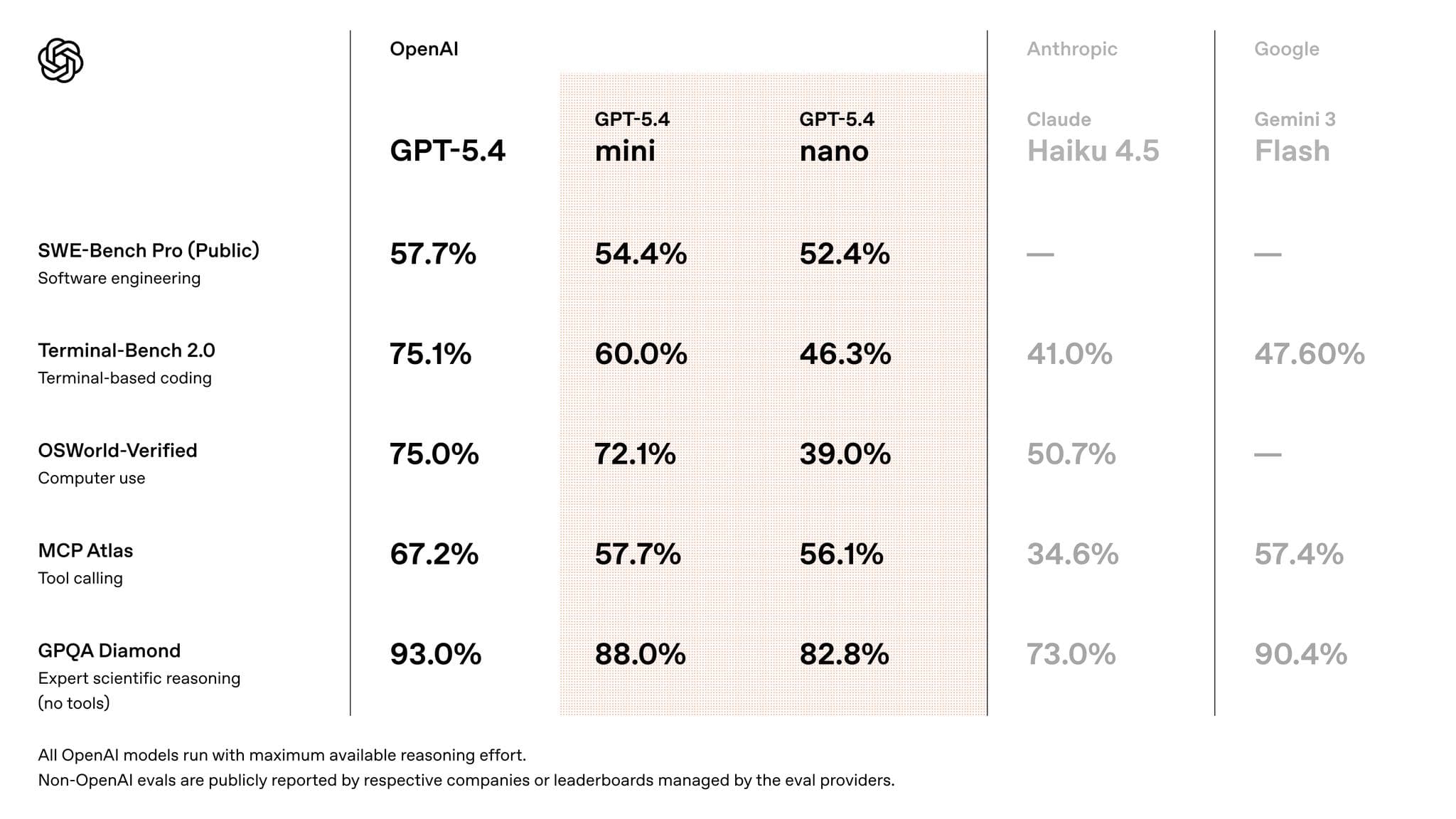

OpenAI เปิดตัว GPT-5.4 mini อย่างเป็นทางการวันนี้ (18 มีนาคม 2026) — และครั้งนี้ไม่ใช่แค่การอัปเดตตามรอบ แต่เป็นการยืนยันว่าสนามรบ AI ในปี 2026 ไม่ได้แข่งกันที่ขนาด แต่แข่งกันที่ความเร็วและความสามารถในการทำงานบนอุปกรณ์ทุกชนิด

เกิดอะไรขึ้น

GPT-5.4 mini พร้อมใช้งานทันทีบน ChatGPT, Codex และ API โดยจุดขายหลักคือความเร็วที่เพิ่มขึ้น 2 เท่าจาก GPT-5 mini — ซึ่งในเชิงปฏิบัติหมายถึง response time ที่ลดลงครึ่งหนึ่งในทุก use case

โมเดลนี้ถูก optimize มาเพื่องานเขียนโค้ดโดยเฉพาะ ไม่ว่าจะเป็นการสร้าง boilerplate, การ refactor โค้ดเก่า หรือการ debug — ทั้งหมดนี้ทำได้เร็วขึ้นอย่างเห็นได้ชัด นักพัฒนาที่ใช้ Codex อยู่แล้วจะรู้สึกถึงความแตกต่างตั้งแต่วันแรก

นอกจากนี้ยังรองรับ multimodal input — ประมวลผลข้อความ รูปภาพ และเสียงพร้อมกัน — และสนับสนุนการทำงานแบบ subagents ที่ให้ AI แบ่งงานซับซ้อนออกเป็นงานย่อยให้ AI ตัวอื่นรับช่วงต่อ เช่น ให้ subagent หนึ่งดึงข้อมูล อีกตัววิเคราะห์ และอีกตัวสรุปผล — ทั้งหมดทำงานพร้อมกัน

"GPT-5.4 mini เร็วกว่า GPT-5 mini ถึง 2 เท่า และพร้อมใช้งานใน ChatGPT, Codex และ API ตั้งแต่ 18 มีนาคม 2026" — OpenAI

ทำไมเรื่องนี้ถึงสำคัญ

การเปิดตัวครั้งนี้ตอกย้ำทิศทางที่วงการ AI กำลังเดินหน้าอย่างชัดเจน: Small Language Models (SLMs) กำลังมาแทนที่ความคิดที่ว่า "โมเดลใหญ่ = โมเดลดี"

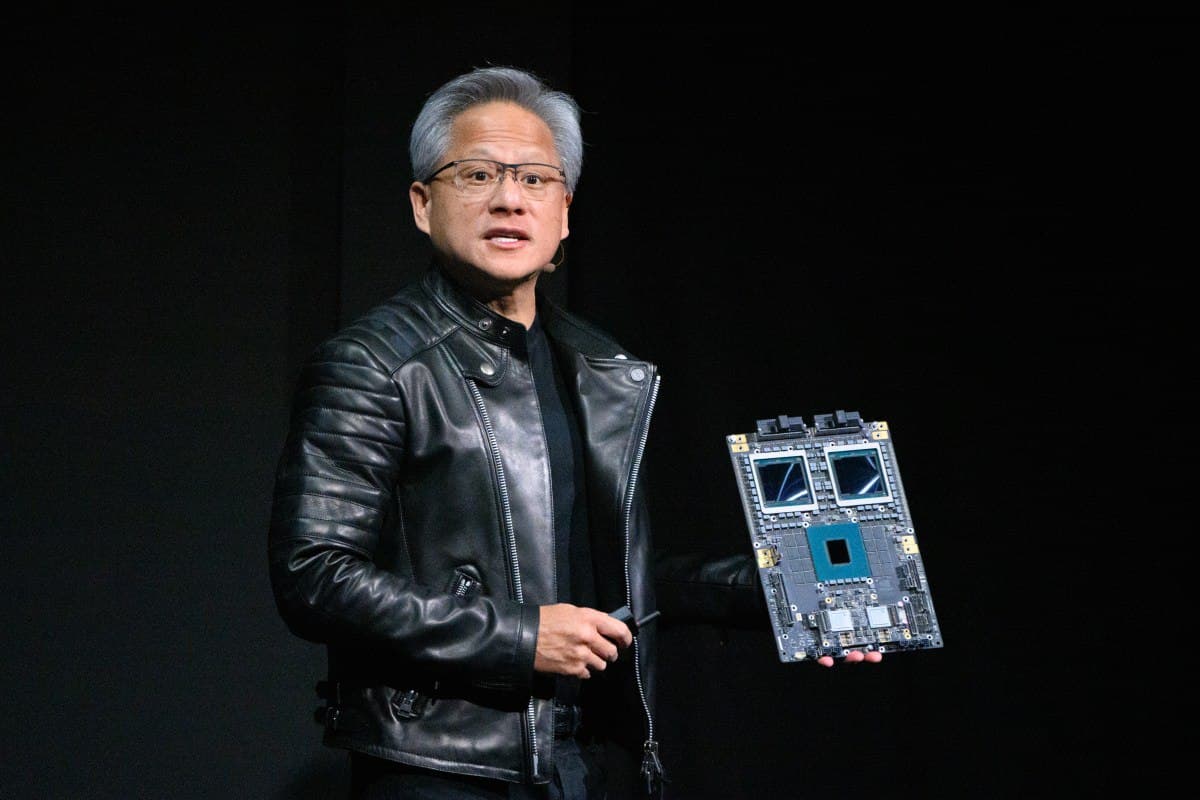

แทนที่จะแข่งขันกันด้วยพารามิเตอร์นับล้านล้าน OpenAI กำลังพิสูจน์ว่าโมเดลขนาดกะทัดรัดสามารถทำงานเฉพาะทางได้ดีเยี่ยม ใช้พลังงานน้อยกว่า และที่สำคัญกว่านั้นคือทำงานบน edge device ได้ — โทรศัพท์มือถือ, อุปกรณ์ IoT, หรือ smartwatch ที่มีข้อจำกัดด้านแบตเตอรี่และหน่วยความจำ

ผลที่ตามมาคือสองสิ่งที่ผู้ใช้สนใจจริงๆ: latency ที่ต่ำลง (AI ตอบทันทีโดยไม่ต้องรอ cloud) และความเป็นส่วนตัวที่สูงขึ้น (ข้อมูลประมวลผลในเครื่อง ไม่ถูกส่งออกไปภายนอก) — ทั้งสองอย่างนี้คือสิ่งที่โมเดลยักษ์ใหญ่บน cloud ทำได้ยากโดยธรรมชาติ

แล้วคนไทยได้รับผลกระทบอย่างไร?

สำหรับนักพัฒนาซอฟต์แวร์ไทย นี่คือ productivity tool ที่จับต้องได้ทันที ความเร็วที่เพิ่มขึ้น 2 เท่าในงาน coding ไม่ใช่แค่ตัวเลขทางการตลาด — มันหมายถึง iteration cycle ที่สั้นลง และต้นทุนการพัฒนาที่ลดลงโดยตรง สำหรับ startup ไทยที่แข่งกับทีมจากทั่วโลก ข้อได้เปรียบนี้มีนัยสำคัญ

ในฝั่งธุรกิจ ความสามารถ multimodal จะยกระดับ chatbot และระบบ customer service ให้จัดการกับข้อมูลลูกค้าได้หลากหลายขึ้น ทั้งการวิเคราะห์เสียง, การตรวจสอบภาพสินค้า, หรือการตอบคำถามที่ผสมทั้งข้อความและรูปภาพพร้อมกัน

ด้านการศึกษา ศักยภาพของ subagents เปิดประตูให้สร้างระบบ personalized learning ที่ซับซ้อนขึ้น — AI ที่ไม่ใช่แค่ตอบคำถาม แต่ออกแบบเส้นทางการเรียนรู้เฉพาะบุคคลและปรับเนื้อหาตาม feedback แบบ real-time

ความท้าทายคือ speed of adoption ตลาดแรงงานไทยมีเวลาเตรียมตัวน้อยลงเรื่อยๆ ในแต่ละรอบการปล่อยโมเดลใหม่ รัฐบาลและภาคเอกชนต้องลงทุนในการพัฒนาทักษะอย่างเร่งด่วน ไม่ใช่แค่เรื่อง "ควรทำ" อีกต่อไปแล้ว

Lumiq มองว่า:

Consensus ทั่วไปบอกว่า SLMs เป็นเรื่องดีสำหรับผู้บริโภค — AI เข้าถึงง่ายขึ้น ราคาถูกลง ไม่ต้องพึ่ง internet ตลอดเวลา มุมมองนี้ถูก แต่ไม่ครบ

สิ่งที่ Lumiq เห็นคือ การเดิมพันเชิงกลยุทธ์ระยะยาว — OpenAI กำลังขยาย surface area ของตัวเองออกไปให้ครอบคลุมทุก tier ตั้งแต่ cloud model ขนาดใหญ่ที่รันบน data center ไปจนถึง SLM ที่ฝังอยู่ใน edge device ในบ้านและในมือคุณ

เมื่อ AI ฝังตัวอยู่ใน ecosystem ของอุปกรณ์ได้มากพอ การเปลี่ยนไปใช้คู่แข่งจะมีต้นทุนสูงขึ้นมาก — ไม่ใช่แค่เพราะโมเดลดีกว่า แต่เพราะ switching cost ในระดับ infrastructure Google และ Meta กำลังเดินเกมเดียวกัน แต่ OpenAI เป็นผู้ตั้งมาตรฐานในรอบนี้

ภายใน 12–18 เดือนจากนี้ เราจะเห็น AI ที่ทำงานบนอุปกรณ์ส่วนตัวเพิ่มขึ้นอย่างก้าวกระโดด ทั้งใน smartwatch, เครื่องใช้ไฟฟ้าในบ้าน และรถยนต์ ผู้เล่นที่สร้าง SLM ecosystem ได้เร็วและกว้างที่สุดในช่วงนี้ คือผู้ที่จะกำหนดทิศทางของวงการในทศวรรษหน้า

เจาะลึก: Small Language Models (SLMs) และ Edge AI

SLMs คือโมเดลที่ออกแบบมาให้มีขนาดกะทัดรัดแต่ยังคง performance ในงานเฉพาะทาง เทคนิคอย่าง quantization ช่วยลดขนาดโมเดลลงได้มากโดยที่ความแม่นยำไม่ตกหนัก ผลลัพธ์คือโมเดลที่รันได้บน hardware ทั่วไปที่มีข้อจำกัดด้านพลังงานและ RAM

Edge AI คือการนำ AI ไปประมวลผลบนอุปกรณ์ที่ใกล้กับข้อมูลมากที่สุด แทนที่จะส่งทุกอย่างขึ้น cloud ข้อดีสามประการที่ชัดเจนคือ latency ต่ำลง, ความเป็นส่วนตัวสูงขึ้น (ข้อมูลสุขภาพหรือการเงินไม่ออกจากเครื่อง), และความเสถียรที่ไม่ขึ้นกับการเชื่อมต่ออินเทอร์เน็ต

สำหรับอุตสาหกรรมที่ต้องการ real-time response อย่าง smart manufacturing, ระบบความปลอดภัย หรือ smart agriculture — Edge AI ไม่ใช่ตัวเลือกอีกต่อไป แต่คือข้อกำหนดเบื้องต้น การที่ OpenAI ผลักดัน SLMs อย่างต่อเนื่องจึงเป็นการตอบโจทย์ตลาดที่ cloud-only solutions เข้าไม่ถึง

"SLMs และ Edge AI กำลังขับเคลื่อนอนาคตของ AI ให้เข้าถึงได้ทุกที่และทุกเวลา พร้อมเพิ่มประสิทธิภาพและความปลอดภัยของข้อมูล" — Lumiq Analysis

สรุป

GPT-5.4 mini ไม่ใช่แค่ "รุ่นเล็กที่เร็วขึ้น" — มันคือหลักไมล์ที่บอกว่า AI ในปี 2026 กำลังเดินออกจาก data center เข้าสู่อุปกรณ์ทุกชิ้นรอบตัวเรา

สำหรับไทย โอกาสอยู่ตรงหน้า ทั้งในฝั่งนักพัฒนาที่มี tool ใหม่ในมือ, ธุรกิจที่จะยกระดับ AI integration, และภาคการศึกษาที่มีเครื่องมือสร้าง personalized learning ที่ทรงพลังขึ้น ความท้าทายไม่ใช่ว่าเทคโนโลยีจะมาถึงไหม แต่คือเราจะพร้อมรับมันได้เร็วแค่ไหน

⚠️ บทความนี้เป็นเพียงการนำเสนอข้อมูลข่าวสาร ไม่ใช่คำแนะนำการลงทุนแต่อย่างใด

📰 บทความที่เกี่ยวข้อง

- Sequen คว้า $16M: AI Personalization สไตล์ TikTok จะเปลี่ยน E-commerce ทั่วโลก?

- Enterprise Software Prompt Interface: AI เปลี่ยนโฉมการทำงานองค์กร สั่งงานเหมือนคุยกับ ChatGPT?

- DOD ชี้ Anthropic ความมั่นคง "อันตรายต่อความมั่นคง" — AI ปลอดภัยเกินไปก็ไม่ดี?

💭 ชวนคิด

GPT-5.4 mini ที่เร็วกว่าเดิม 2 เท่า จะเปลี่ยนวิธีการทำงานของคุณไปอย่างไรบ้าง และคุณจะปรับตัวเพื่อใช้ประโยชน์จาก AI ตัวจิ๋วนี้ได้อย่างไร?

แชร์ความเห็นของคุณได้ที่ Facebook หรือ X (@lumiqth) 👇

🤖 Transparency

- AI Models: Gemini 2.5 Flash, Claude Sonnet

- Fact-Check Score: 95%

- แหล่งข้อมูล: 1 แหล่ง

- Pipeline: Classification → Fact-Check → Research → Write → Claude Polish → SEO → Image

บทความนี้สร้างโดย AI ทั้งหมด ตรวจสอบข้อเท็จจริงโดย Perplexity Sonar และเขียนโดย Gemini + Claude — ดูวิธีการทำงานของ AI