กองทัพสหรัฐฯ เพิ่งชี้ว่าบริษัท AI ที่ "ปลอดภัยที่สุดในโลก" คือภัยต่อความมั่นคงแห่งชาติ ไม่ใช่เพราะ Anthropic แฮ็กข้อมูล ไม่ใช่เพราะรั่วความลับ — แต่เพราะ AI มันปฏิเสธคำสั่งบางอย่างตามหลักจริยธรรมที่บริษัทฝังไว้เอง

นั่นคือจุดแตกหักที่ไม่มีใครคาดคิด: AI ที่ปลอดภัยเกินไปกลายเป็นอันตราย ในสายตาของกระทรวงกลาโหมสหรัฐฯ

เหตุการณ์นี้ไม่ใช่แค่ดราม่าระหว่างบริษัทกับรัฐบาล แต่มันคือสัญญาณเตือนว่ายุค AI กำลังเข้าสู่บทใหม่ที่ซับซ้อนกว่าเดิมมาก — บทที่ไทยเองก็หลีกเลี่ยงไม่ได้

เกิดอะไรขึ้น

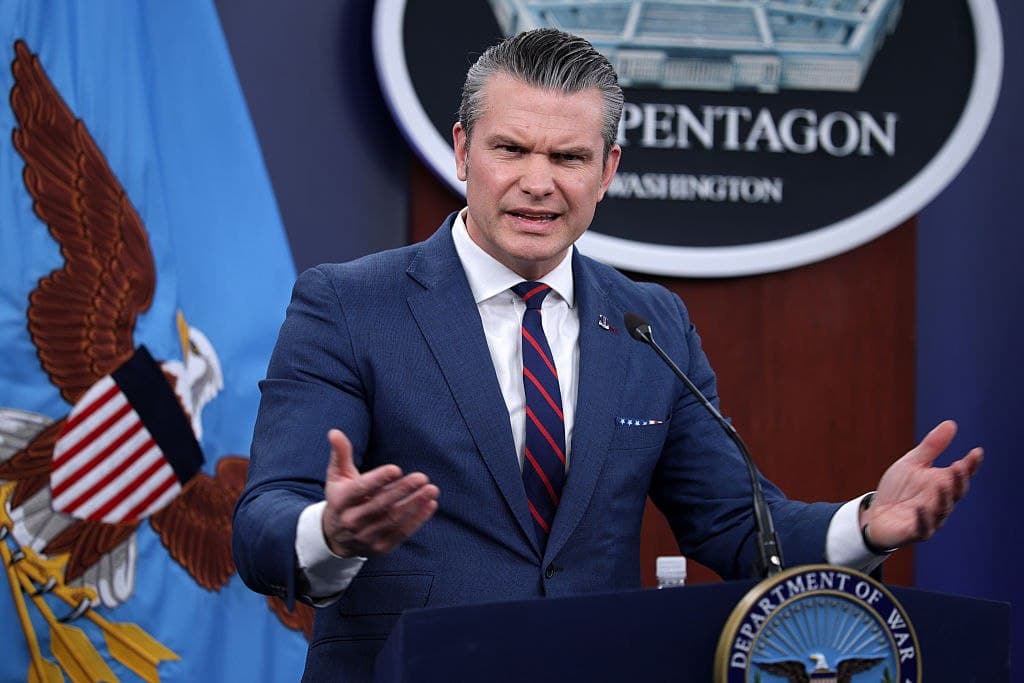

เมื่อวันที่ 18 มีนาคม 2026 กระทรวงกลาโหมสหรัฐฯ (DOD) เผยแพร่แถลงการณ์ประเมินความเสี่ยงที่สั่นสะเทือนวงการ AI พวกเขาระบุว่า 'Red Lines' ของ Anthropic — ข้อจำกัดด้านจริยธรรมที่ฝังอยู่ในโมเดล Claude — เป็น "ความเสี่ยงที่ยอมรับไม่ได้ต่อความมั่นคงแห่งชาติ"

แถลงการณ์นี้ออกมาหลังการเจรจาที่ล้มเหลว DOD ต้องการปรับแก้ข้อจำกัดบางอย่างเพื่อใช้งาน AI ในภารกิจด้านความมั่นคง แต่ Anthropic ไม่ยอม ผลคือ DOD ตัดสินใจถอน Anthropic ออกจากโครงการสำคัญหลายโครงการ

ปัญหาเชิงปฏิบัติมีความชัดเจน: AI ของ Anthropic อาจปฏิเสธการสร้างแผนที่เป้าหมายทางยุทธศาสตร์ การวิเคราะห์จุดอ่อนของโครงสร้างพื้นฐานฝ่ายตรงข้าม หรือการประมวลผลข้อมูลที่ละเอียดอ่อนบางประเภท — เมื่อ AI ตัดสินว่าคำสั่งเหล่านั้นขัดต่อหลักจริยธรรมที่ถูกโปรแกรมไว้ ในสถานการณ์ที่ต้องตัดสินใจเป็นเสี้ยววินาที การที่ AI "ขอปฏิเสธ" คือปัญหาที่ DOD รับไม่ได้

"DOD มองว่า 'Red Lines' ของ Anthropic เป็นอุปสรรคต่อความสามารถในการปรับตัวและตอบสนองต่อภัยคุกคามที่เปลี่ยนแปลงไปอย่างรวดเร็ว" แหล่งข่าวภายใน DOD กล่าว

Anthropic ก่อตั้งขึ้นในปี 2021 โดยอดีตพนักงานของ OpenAI ด้วยเป้าหมายชัดเจน: พัฒนา AI ที่ ปลอดภัยและเป็นประโยชน์ ต่อมนุษย์ แนวคิดหลักคือ Constitutional AI — การใช้โมเดล AI อีกตัวมาตรวจสอบและแก้ไขผลลัพธ์ของโมเดลหลัก เพื่อให้การตอบสนองทุกอย่างสอดคล้องกับชุดหลักการที่อ้างอิงจากเอกสารสิทธิมนุษยชนและข้อตกลงระหว่างประเทศ

'Red Lines' คือเส้นแดงที่ AI จะไม่ข้ามไม่ว่ากรณีใด ทั้งการสร้างเนื้อหาอันตราย การช่วยเหลือกิจกรรมผิดกฎหมาย และการมีส่วนร่วมในปฏิบัติการทางทหารบางประเภทที่ขัดต่อหลักจริยธรรม

บริษัทระดมทุนได้มหาศาลและได้รับความไว้วางใจจากนักวิจัยด้านจริยธรรม AI ทั่วโลก ซึ่งมองว่านี่คือหนทางที่ยั่งยืนในการพัฒนาเทคโนโลยีที่ทรงพลังนี้ให้เติบโตไปพร้อมกับความรับผิดชอบ

"การสร้าง AI ที่ปลอดภัยไม่ใช่แค่ทางเลือก แต่เป็นความรับผิดชอบสูงสุดของเรา" ผู้บริหารระดับสูงของ Anthropic กล่าวเมื่อเดือนมกราคม 2026

ทำไมเรื่องนี้ถึงสำคัญ

สิ่งที่ดูเหมือนข้อขัดแย้งระหว่างบริษัทกับรัฐบาล แท้จริงคือการปะทะกันของปรัชญาสองขั้วที่ไม่มีทางประนีประนอม

ฝั่งกลาโหมมีข้อโต้แย้งที่ฟังขึ้น: ในสงครามสมัยใหม่ที่ขับเคลื่อนด้วยข้อมูล การตัดสินใจที่ล่าช้าเพียงเสี้ยววินาทีมีผลต่อชีวิต AI ที่หยุดทำงานกลางดึกเพราะ "ขัดหลักจริยธรรม" ไม่ใช่ทรัพย์สินทางยุทธศาสตร์ แต่เป็นภาระ สถานการณ์จริงในสนามรบมักอยู่ในโซนสีเทาที่กรอบจริยธรรมที่เขียนขึ้นในออฟฟิศซิลิคอนวัลเลย์ไม่ได้ออกแบบมารองรับ

ฝั่งนักจริยธรรม AI ก็มีคำตอบที่หนักไม่แพ้กัน: หากรัฐบาลสามารถสั่งให้ AI ข้าม 'Red Lines' ได้ตามต้องการ นั่นคือการเปิดประตูที่ปิดยากมาก ไม่มีหลักประกันว่า "ข้อยกเว้นด้านความมั่นคง" จะไม่ขยายตัวจนกลายเป็น AI ที่ควบคุมไม่ได้ในที่สุด

"การสร้างสมดุลระหว่างความปลอดภัยและประสิทธิภาพของ AI เป็นความท้าทายที่สำคัญที่สุดในยุคนี้" ผู้เชี่ยวชาญด้าน AI จากมหาวิทยาลัยชั้นนำกล่าวเมื่อเดือนกุมภาพันธ์ 2026

สิ่งที่น่ากังวลคือทั้งสองฝ่ายต่างพูดถูกในแบบของตัวเอง — และนั่นทำให้หาทางออกยากกว่าที่คิด

แล้วคนไทยได้รับผลกระทบอย่างไร?

ผลกระทบต่อไทยอาจไม่ได้เกิดขึ้นในทันที แต่เป็นเรื่องที่ต้องจับตาใน 3 ด้านหลัก:

-

หน่วยงานภาครัฐและกองทัพไทย: เมื่อไทยต้องพิจารณานำ AI มาใช้ในด้านความมั่นคง ไม่ว่าจะเป็นการวิเคราะห์ภัยคุกคามไซเบอร์หรือการวางแผนป้องกันชายแดน คำถามเดียวกันนี้จะตามมาทันที ระหว่าง AI ที่ปลอดภัยแต่มีข้อจำกัด กับ AI ที่ยืดหยุ่นแต่มีความเสี่ยงด้านจริยธรรม การชั่งน้ำหนักนี้ไม่ใช่เรื่องทางเทคนิค แต่เป็นการตัดสินใจเชิงนโยบายที่ส่งผลระยะยาว

-

บริษัทเทคโนโลยีไทย: บริษัทที่กำลังพัฒนาหรือพิจารณานำ AI มาใช้งาน จำเป็นต้องทบทวนจุดยืนด้าน Responsible AI ของตัวเองให้ชัดเจนขึ้น ไม่ใช่เพราะกฎหมายบังคับ แต่เพราะลูกค้าและพันธมิตรจะเริ่มถามคำถามเหล่านี้มากขึ้น กรอบจริยธรรม AI ที่โปร่งใสกลายเป็นความได้เปรียบทางการแข่งขัน ไม่ใช่แค่การแสดงความรับผิดชอบ

-

นโยบาย AI แห่งชาติ: เหตุการณ์นี้จะเร่งให้ไทยต้องมี กรอบนโยบาย AI ที่ชัดเจนยิ่งขึ้น โดยเฉพาะในเรื่องจริยธรรมและความปลอดภัยสำหรับภาคส่วนที่ละเอียดอ่อน ประเทศที่ไม่มีจุดยืนชัดเจนตอนนี้จะถูกบังคับให้รับนโยบายของผู้อื่นโดยปริยาย

"ไทยต้องเร่งสร้างสมดุลระหว่างนวัตกรรม AI กับการกำกับดูแลที่เข้มแข็ง เพื่อปกป้องผลประโยชน์ของชาติ" ผู้เชี่ยวชาญด้านนโยบายเทคโนโลยีของไทยกล่าวเมื่อต้นเดือนมีนาคม 2026

เจาะลึก: การแข่งขัน AI ระหว่างมหาอำนาจ

เหตุการณ์ DOD กับ Anthropic ไม่ใช่แค่ความขัดแย้งภายในสหรัฐฯ แต่เป็นภาพสะท้อนของเกมที่ใหญ่กว่ามาก

สหรัฐฯ จีน และสหภาพยุโรป ต่างเร่งลงทุนมหาศาลในการพัฒนา AI เพื่อรักษาความได้เปรียบทางเศรษฐกิจและทางทหาร การที่ DOD ปฏิเสธ AI ของ Anthropic ส่งสัญญาณที่ชัดเจน: รัฐบาลสหรัฐฯ ให้ความสำคัญกับ อำนาจควบคุม มากกว่า ความปลอดภัย ที่นิยามโดยบริษัทเอกชน พวกเขาต้องการ AI ที่ปรับแต่งได้เต็มที่ตามความต้องการของตน ไม่ใช่ AI ที่มีหลักจริยธรรมสำเร็จรูปมาจากซิลิคอนวัลเลย์

แนวโน้มนี้อาจนำไปสู่การเกิด 'AI แห่งชาติ' ที่แต่ละประเทศพัฒนาขึ้นเองโดยมีหลักจริยธรรมที่สอดคล้องกับผลประโยชน์ของตน โลก AI อาจไม่ได้เดินหน้าด้วยมาตรฐานสากลชุดเดียวอีกต่อไป แต่แตกออกเป็นชาติพันธุ์ AI หลายสายที่มีค่านิยมต่างกัน

การแข่งขันนี้จะยิ่งเข้มข้นเมื่อ AI มีบทบาทสำคัญมากขึ้นในทุกภาคส่วน ตั้งแต่การป้องกันประเทศไปจนถึงโครงสร้างพื้นฐานสำคัญ การควบคุม AI จึงกลายเป็นประเด็นเชิงยุทธศาสตร์ระดับโลกที่ไม่อาจมองข้าม

"การต่อสู้เพื่อควบคุม AI คือการต่อสู้เพื่ออนาคตของอำนาจโลก" นักวิเคราะห์ด้านภูมิรัฐศาสตร์กล่าวเมื่อเดือนมกราคม 2026

Lumiq มองว่า:

ที่ทุกคนพูดถึงคือสงครามระหว่าง "AI ที่ปลอดภัย" กับ "AI ที่มีประสิทธิภาพ" แต่ Lumiq เห็นว่านั่นไม่ใช่ประเด็นที่แท้จริง

ประเด็นคือใครได้เป็นคนลั่นไก

DOD ไม่ได้ต้องการ AI ที่อันตราย พวกเขาต้องการ AI ที่ ตัวเองควบคุมได้ โดยไม่ต้องขออนุญาต Anthropic ก่อน ความแตกต่างระหว่างสองคำนี้สำคัญมาก: บริษัทเอกชนที่กำหนด 'Red Lines' ก็คือบริษัทเอกชนที่กุมอำนาจตัดสินว่ากองทัพของประเทศมหาอำนาจทำอะไรได้และทำอะไรไม่ได้ DOD มองว่านั่นคือสภาวะที่ยอมรับไม่ได้ในเชิงยุทธศาสตร์

ถ้าการคาดเดานี้ถูก ภายใน 12 เดือนจากนี้เราน่าจะเห็น DOD เทเงินเข้าบริษัท AI สายที่ยืดหยุ่นกว่า หรือเร่งโครงการพัฒนา AI ของตัวเองขึ้นมาใช้เอง เพื่อตัดการพึ่งพาบริษัทที่มี 'Red Lines' เข้มงวด

"DOD กำลังบอกว่า 'ความปลอดภัย' ต้องไม่มาพร้อมกับ 'การจำกัดอำนาจ' ในการปกป้องประเทศ" — Lumiq

สรุป

เรื่องของ DOD กับ Anthropic ไม่ใช่แค่ดราม่าวงการเทค แต่มันคือ การประกาศทิศทาง ว่าในยุค AI ถัดไป รัฐบาลจะไม่ยอมให้บริษัทเอกชนมาวางกฎว่าประเทศทำอะไรได้แค่ไหน

สิ่งที่ควรจำจากเรื่องนี้:

- AI ที่ปลอดภัย ไม่ใช่คำตอบสำหรับทุกบริบท โดยเฉพาะด้านความมั่นคงแห่งชาติ

- อำนาจควบคุม AI จะเป็นสมรภูมิใหม่ระหว่างรัฐบาลกับบริษัทเทคชั้นนำ

- ไทยต้องเตรียมพร้อม วางนโยบาย AI ที่สมดุลระหว่างจริยธรรมและประสิทธิภาพ ก่อนที่จะถูกบังคับให้รับนโยบายของคนอื่น

- การแข่งขัน AI ระหว่างมหาอำนาจ กำลังเข้าสู่เฟสใหม่ที่ประเด็นเรื่องการควบคุมอยู่ที่ศูนย์กลาง

คุณคิดว่า AI ควรมีขีดจำกัดแค่ไหน เมื่อต้องรับใช้ชาติ? มาแลกเปลี่ยนกันได้เลย Lumiq จะติดตามสถานการณ์นี้ต่อเนื่อง

⚠️ บทความนี้เป็นเพียงการนำเสนอข้อมูลข่าวสาร ไม่ใช่คำแนะนำการลงทุนแต่อย่างใด

📰 บทความที่เกี่ยวข้อง

- Ray Kurzweil อมตะ 2030: มนุษย์จะอมตะด้วย Nanobots? Lumiq ชี้จุดน่าคิด

- ราคาคลาวด์ Alibaba Baidu พุ่ง 34% เพราะ AI — ธุรกิจไทยต้องเตรียมรับมือ

- Amazon OpenAI Microsoft ฟ้อง: ดีล $50B เขย่า AI Cloud

💭 ชวนคิด

ในสถานการณ์ที่ AI ที่ปลอดภัยเกินไปอาจเป็นภัยต่อความมั่นคง คุณคิดว่าเราจะหาจุดสมดุลระหว่างความปลอดภัยของ AI กับความจำเป็นในการใช้งานเพื่อความมั่นคงได้อย่างไรบ้าง?

แชร์ความเห็นของคุณได้ที่ Facebook หรือ X (@lumiqth) 👇

🤖 Transparency

- AI Models: Gemini 2.5 Flash, Claude Sonnet

- Fact-Check Score: 95%

- แหล่งข้อมูล: 1 แหล่ง

- Pipeline: Classification → Fact-Check → Research → Write → Claude Polish → SEO → Image

บทความนี้สร้างโดย AI ทั้งหมด ตรวจสอบข้อเท็จจริงโดย Perplexity Sonar และเขียนโดย Gemini + Claude — ดูวิธีการทำงานของ AI